Desde os primórdios da computação em nuvem, arquitetos de software e líderes de infraestrutura convivem com um dilema na hora de desenhar sistemas: a escolha rígida entre Armazenamento de Objetos e File Systems (Sistemas de Arquivos).

De um lado, temos o Amazon S3 — absurdamente barato, infinitamente escalável e incrivelmente durável. O problema? Ele guarda “objetos” inteiros e imutáveis. Se você quiser alterar uma única linha em um arquivo de log de 10 GB no S3, você precisa baixar o arquivo, alterar a linha e fazer o upload de tudo novamente. Do outro lado, soluções como o Amazon EFS ou FSx operam como os discos rígidos tradicionais, permitindo edição de arquivos byte a byte de forma interativa, mas com um custo mensal significativamente mais alto.

Até hoje, empresas resolviam isso criando “gambiarras” arquiteturais: duplicando terabytes de dados do S3 para discos temporários de alta performance toda vez que uma aplicação precisava manipular arquivos. Com o lançamento do AWS S3 Files, a Amazon acabou de eliminar essa barreira estrutural.

A Convergência entre Custo e Interatividade

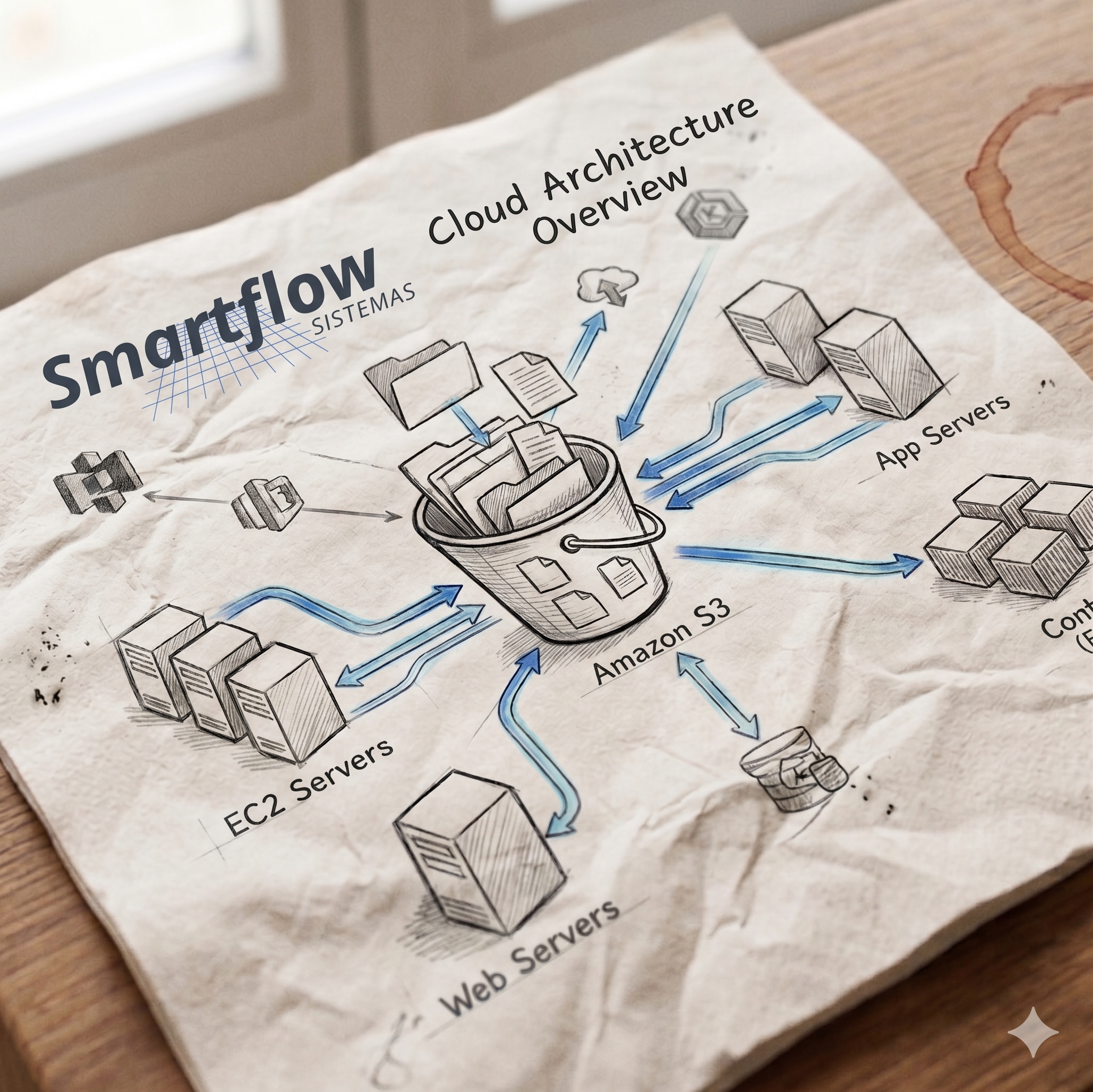

Para o gestor que olha para a fatura de nuvem e para a velocidade de entrega do time de engenharia, o S3 Files é um divisor de águas. A nova funcionalidade permite que você pegue um bucket padrão do S3 e o “monte” nativamente nas suas instâncias EC2, contêineres (ECS/EKS) ou funções Lambda como se fosse um disco de rede local (usando o protocolo NFS v4.1).

O impacto operacional disso é imediato. Se a sua empresa possui aplicações legadas que só sabem ler e escrever em diretórios locais de um sistema operacional, você não precisa mais reescrever todo o código-fonte para interagir com as APIs REST do S3. A aplicação continua gravando na pasta local, sem saber que, por trás dos panos, está salvando dados no armazenamento de objetos mais robusto do mundo.

Além disso, na era da Inteligência Artificial, pipelines de Machine Learning e agentes de IA (Agentic AI) exigem leitura rápida e iterativa de datasets gigantescos. O S3 Files elimina o tempo de espera de ficar copiando gigabytes do S3 para discos de processamento antes de rodar os modelos. A infraestrutura passa a compartilhar uma única fonte da verdade, sem silos e sem duplicação de dados.

Sob o Capô: Baixa Latência e Sincronização Automática

Do ponto de vista de engenharia, como a AWS fez um armazenamento de objetos responder com a agilidade de um disco local? A inteligência do S3 Files baseia-se em utilizar a tecnologia do Amazon EFS como uma camada invisível de aceleração.

Quando você acessa a pasta mapeada, o sistema entrega latências na casa de 1 milissegundo para dados ativos. Ele utiliza “pre-fetching” inteligente para antecipar quais dados sua aplicação vai pedir em seguida, e garante a leitura e escrita em byte-range (modificando e transferindo apenas o pedaço do arquivo que foi alterado).

Quando a aplicação escreve ou atualiza um arquivo, o S3 Files gerencia toda a sincronização de fundo (em background), exportando as atualizações como novos objetos ou novas versões de volta para o seu bucket S3 em minutos. Tudo isso respeitando perfeitamente o controle de permissões POSIX (usuários e grupos) cruzado com o IAM da AWS.

Modernizando a Nuvem sem Reescrever Código

A introdução do AWS S3 Files simplifica arquiteturas complexas, destruindo silos de dados e permitindo que o S3 se torne o hub central definitivo para todas as cargas de trabalho interativas da empresa. Contudo, adotar essa tecnologia exige planejamento. Misturar políticas de segurança do IAM com permissões de rede NFS exige rigor, e mapear quais cargas de trabalho migrar para esse novo modelo é fundamental para otimizar os custos de leitura e gravação.

É nesse ponto cego entre as novidades arquiteturais da nuvem e a realidade da sua operação que a Smartflow Sistemas atua. Nossa consultoria não apenas refatora código, mas ajuda as empresas a modernizarem suas topologias AWS, identificando onde a duplicação de dados está drenando o orçamento e implementando integrações como o S3 Files de forma segura dentro de sistemas legados e pipelines de IA.

Sua infraestrutura cloud deve acelerar a sua operação, e não forçar sua equipe a gerenciar cópias desnecessárias de dados.